(씨넷코리아=정하정 기자) 샌디스크가 AI 데이터센터와 엣지 컴퓨팅 환경을 위한 차세대 메모리 구조 ‘고대역폭 플래시 메모리(HBF)’를 8일 공개했다.

알퍼 일크바하르 샌디스크 CTO는 “AI 확산으로 데이터센터 구조 자체가 빠르게 변화하고 있다”고 설명했다. 현재 AI 워크로드를 처리할 수 있는 데이터센터 비중은 약 7분의 1 수준이지만 2030년에는 약 70%까지 확대될 것으로 전망된다.

문제는 기존 메모리 구조다. 현재 AI 인프라 핵심 메모리인 DRAM과 HBM은 대규모 AI 모델 확산에 따라 용량과 집적도, 전력 효율 측면에서 한계를 드러내고 있다. 특히 엔터프라이즈 데이터센터와 엣지 AI 환경에서는 공간과 전력 제약까지 겹치며 비용 부담이 커지고 있다.

샌디스크는 이러한 문제의 원인으로 AI 추론 환경 변화를 지목했다. AI 학습과 달리 AI 추론은 대규모 모델 저장과 대용량 KV 캐시 관리가 중요해지면서 기존 HBM 중심 구조와 다른 메모리 특성이 필요해졌다는 설명이다.

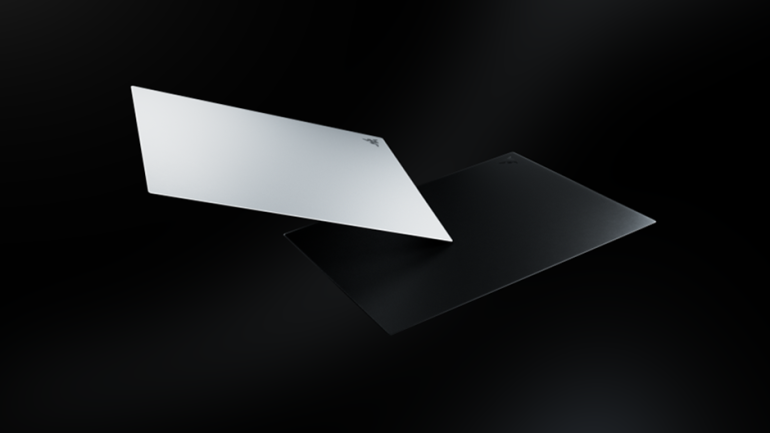

이에 샌디스크가 제시한 기술이 ‘HBF’다. HBF는 NAND 플래시 기반의 차세대 메모리 구조로, AI 추론에 필요한 대용량·고대역폭·저전력 특성을 동시에 겨냥한다.

특히 샌디스크 BiCS NAND와 CBA(CMOS Bonded Array) 기술을 활용, 기존 NAND 구조를 재설계했다. 병렬 처리와 적층 구조 최적화를 통해 읽기 대역폭을 높이고 지연 시간을 줄여 대형 언어 모델(LLM)이 DRAM에 가까운 속도로 데이터를 처리할 수 있도록 설계됐다.

비휘발성 메모리라는 점도 특징 중 하나다. 전원이 꺼져도 데이터를 유지할 수 있으며 높은 동작 온도에서도 안정성을 확보할 수 있다. 이를 통해 엣지 AI 디바이스와 엔터프라이즈 환경에서 보다 효율적인 AI 추론이 가능하다는 설명이다.

샌디스크는 HBF를 통해 스마트폰과 같은 엣지 디바이스에서도 보다 복잡한 AI 추론 작업을 수행할 수 있을 것으로 기대하고 있다. 또한 HBM 기반 GPU 클러스터 구축이 어려운 중소 규모 엔터프라이즈 환경에서도 AI 모델 미세 조정과 추론 성능 향상에 기여할 수 있다고 강조했다.

일크바하르 CTO는 “이제는 대규모 추론 모델 시대에 맞춰 데이터센터와 엣지 메모리 구조를 다시 고민해야 할 시점”이라며 “HBF는 AI 추론에 필요한 용량과 처리량을 동시에 충족하는 차세대 시스템 메모리가 될 것”이라고 설명했다.